负载均衡是一种技术,用于将流量分配到多个服务器,以提高性能和可靠性。反向代理是负载均衡的一种特殊类型,它通过将客户端请求转发到后端服务器来工作。

反向代理服务器充当客户端和后端服务器之间的中介。当客户端向反向代理服务器发送请求时,服务器将请求转发到最合适的后端服务器,该服务器将处理请求并向客户端返回响应。

反向代理具有以下优点:

- 增强性能:反向代理服务器可以缓存经常请求的内容,从而减少后端服务器的负载并提高性能。

- 提高可靠性:如果后端服务器之一出现故障,反向代理服务器可以将流量重定向到其他服务器,确保服务不会中断。

- 安全性:反向代理服务器可以充当防火墙,阻止恶意流量进入内部网络。

- 弹性:反向代理服务器可以根据需要轻松添加或删除后端服务器,从而提供可扩展性和弹性。

反向代理最常见于以下场景:

- Web 应用程序:用于负载平衡 Web 服务器,提高性能和可靠性。

- API 网关:用于管理和保护 API 访问,同时提供负载均衡和安全性。

- 邮件服务器:用于平衡邮件流量,提高邮件交付能力。

- 数据库服务器:用于平衡数据库查询,提高数据库性能。

负载均衡反向代理是一种强大的技术,可用于提高性能、可靠性、安全性以及应用程序和服务的弹性。

正向代理、反向代理、负载均衡(转载)

说到代理,首先我们要明确一个概念,所谓代理就是一个代表、一个渠道;此时就涉及到两个角色,一个是被代理角色,一个是目标角色。

被代理角色通过这个代理访问目标角色完成一些任务的过程称为代理操作过程;如同生活中的专卖店,客人到 adidas 专卖店买了一双鞋,这个专卖店就是代理,被代理角色就是 adidas 厂家,目标角色就是用户。

说反向代理之前,我们先看看正向代理,正向代理也是大家最常接触到的代理模式,我们会从两个方面来说关于正向代理的处理模式,分别从软件方面和生活方面来解释一下什么叫正向代理。

在如今的网络环境下,我们如果由于技术需要要去访问国外的某些网站,此时你会发现位于国外的某网站我们通过浏览器是没有办法访问的。

此时大家可能都会用一个操作 FQ 进行访问,FQ 的方式主要是找到一个可以访问国外网站的代理服务器,我们将请求发送给代理服务器,代理服务器去访问国外的网站,然后将访问到的数据传递给我们!

上述这样的代理模式称为正向代理,正向代理最大的特点是客户端非常明确要访问的服务器地址;服务器只清楚请求来自哪个代理服务器,而不清楚来自哪个具体的客户端;正向代理模式屏蔽或者隐藏了真实客户端信息。

来看个示意图(我把客户端和正向代理框在一块,同属于一个环境,后面我有介绍):

客户端必须设置正向代理服务器,当然前提是要知道正向代理服务器的 IP 地址,还有代理程序的端口。

如下图:

明白了什么是正向代理,我们继续看关于反向代理的处理方式,举例如我国的某宝网站,每天同时连接到网站的访问人数已经爆表,单个服务器远远不能满足人民日益增长的购买欲望了。

此时就出现了一个大家耳熟能详的名词:分布式部署;也就是通过部署多台服务器来解决访问人数限制的问题。

某宝网站中大部分功能也是直接使用 Nginx 进行反向代理实现的,并且通过封装 Nginx 和其他的组件之后起了个高大上的名字: Tengine 。有兴趣的童鞋可以访问 Tengine 的官网查看具体的信息

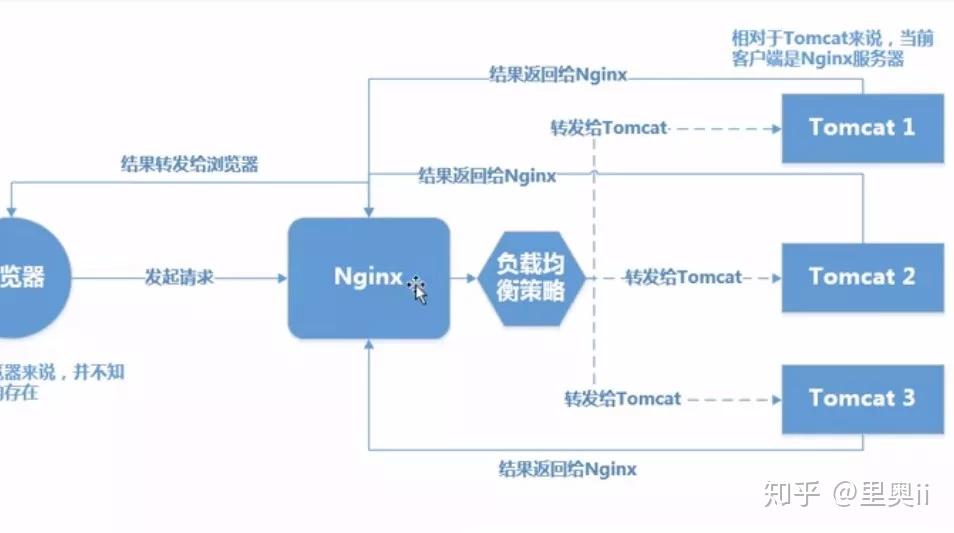

那么反向代理具体是通过什么样的方式实现的分布式的集群操作呢,我们先看一个示意图(我把服务器和反向代理框在一块,同属于一个环境,后面我有介绍):

通过上述的图解大家就可以看清楚了,多个客户端给服务器发送的请求,Nginx 服务器接收到之后,按照一定的规则分发给了后端的业务处理服务器进行处理了。

客户端是无感知代理的存在的,反向代理对外都是透明的,访问者并不知道自己访问的是一个代理。因为客户端不需要任何配置就可以访问。

项目场景

通常情况下,我们在实际项目操作时,正向代理和反向代理很有可能会存在同一个应用场景中,正向代理代理客户端的请求去访问目标服务器,目标服务器是一个反向单利服务器,反向代理了多台真实的业务处理服务器。

具体的拓扑图如下:

截了一张图来说明正向代理和反向代理二者之间的区别,如下图:

我们已经明确了所谓代理服务器的概念,那么接下来,Nginx 扮演了反向代理服务器的角色,它是依据什么样的规则进行请求分发的呢?不用的项目应用场景,分发的规则是否可以控制呢?

这里提到的客户端发送的、Nginx 反向代理服务器接收到的请求数量,就是我们说的负载量。请求数量按照一定的规则进行分发,到不同的服务器处理的规则,就是一种均衡规则。

所以将服务器接收到的请求按照规则分发的过程,称为负载均衡。

负载均衡在实际项目操作过程中,有硬件负载均衡和软件负载均衡两种,硬件负载均衡也称为硬负载,如 F5 负载均衡,相对造价昂贵成本较高。

但是数据的稳定性安全性等等有非常好的保障,如中国移动中国联通这样的公司才会选择硬负载进行操作。

更多的公司考虑到成本原因,会选择使用软件负载均衡,软件负载均衡是利用现有的技术结合主机硬件实现的一种消息队列分发机制。

Nginx 支持的负载均衡调度算法方式如下:

Web 服务器对比

源自:

lb项目是什么意思?

LB项目是指“Load Balancing项目”,意为负载均衡项目。

它是一种网络技术,可以将网络流量在多个服务器之间平衡分配,从而提高整个网络的性能和可靠性。

负载均衡可以通过多种方式实现,包括IP负载均衡、DNS负载均衡、应用层负载均衡等。

LB项目经常应用于Web服务器、应用服务器、数据库服务器等高性能网络架构中。

LB项目的主要作用是平衡网络负载,确保整个网络的高效可靠运行。

它可以分配网络流量,使得各个服务器均衡承担服务的负荷,提高了应用的可用性和性能,有效地缓解了网络拥堵和单点故障等问题。

此外,LB项目还可以根据网络流量的变化自动调整负载均衡策略,确保高峰期内网络和服务器的稳定运行。

LB项目在许多网络架构中都扮演着重要的角色。

特别是在企业级应用中,LB项目的应用非常普遍。

例如,通过在多个服务器上安装同一个应用,实现应用的负载均衡,提高整个应用的性能和可靠性;在高并发的Web服务器中,可以利用LB技术将用户请求分发到多个Web节点上,提高用户的访问速度和体验等。

总之,LB项目的应用范围非常广泛,用途十分丰富。

负载分流是什么意思图片?

负载分流是一种通过将流量分配到不同的服务器上,以提高网站性能和可靠性的技术。

繁忙的网站往往需要处理大量的请求,如果所有请求都由单一的服务器处理,很容易造成服务器过载和网站崩溃。

通过将请求分配到不同的服务器上,负载分流能够减轻单一服务器的负担,并增加网站的容错能力。

负载分流可以通过不同的方式实现,例如基于硬件的负载均衡器、DNS轮询、IP隧道、反向代理等。

基于硬件的负载均衡器通常是最常见的方法,它能够将请求根据某些条件分配到不同的服务器上,提高网站的吞吐量和可用性。

DNS轮询则是通过将DNS记录设置为多个IP地址,使得每个请求能够随机地访问不同的服务器。

IP隧道则是一种把流量转发到多个服务器的方法,这些方法需要中间人应用程序的支持。

反向代理则是一种通过代理服务器转发请求的方法。

选择不同的负载分流方式需要根据实际情况进行选择。

负载分流不仅适用于网站,也适用于不同类型的应用程序。

例如大规模分布式数据库系统和云计算系统均采用了负载分流技术。

在这些应用程序中,负载分流能够有效地平衡负载,提高系统的性能和可用性。

总之,负载分流是一种十分重要的技术,能够为企业和用户提供更好的服务体验。

亿动网

亿动网